MadoberIA

Tu Blog sobre IA y Automatizaciones

MadoberIA

Tu Blog sobre IA y Automatizaciones

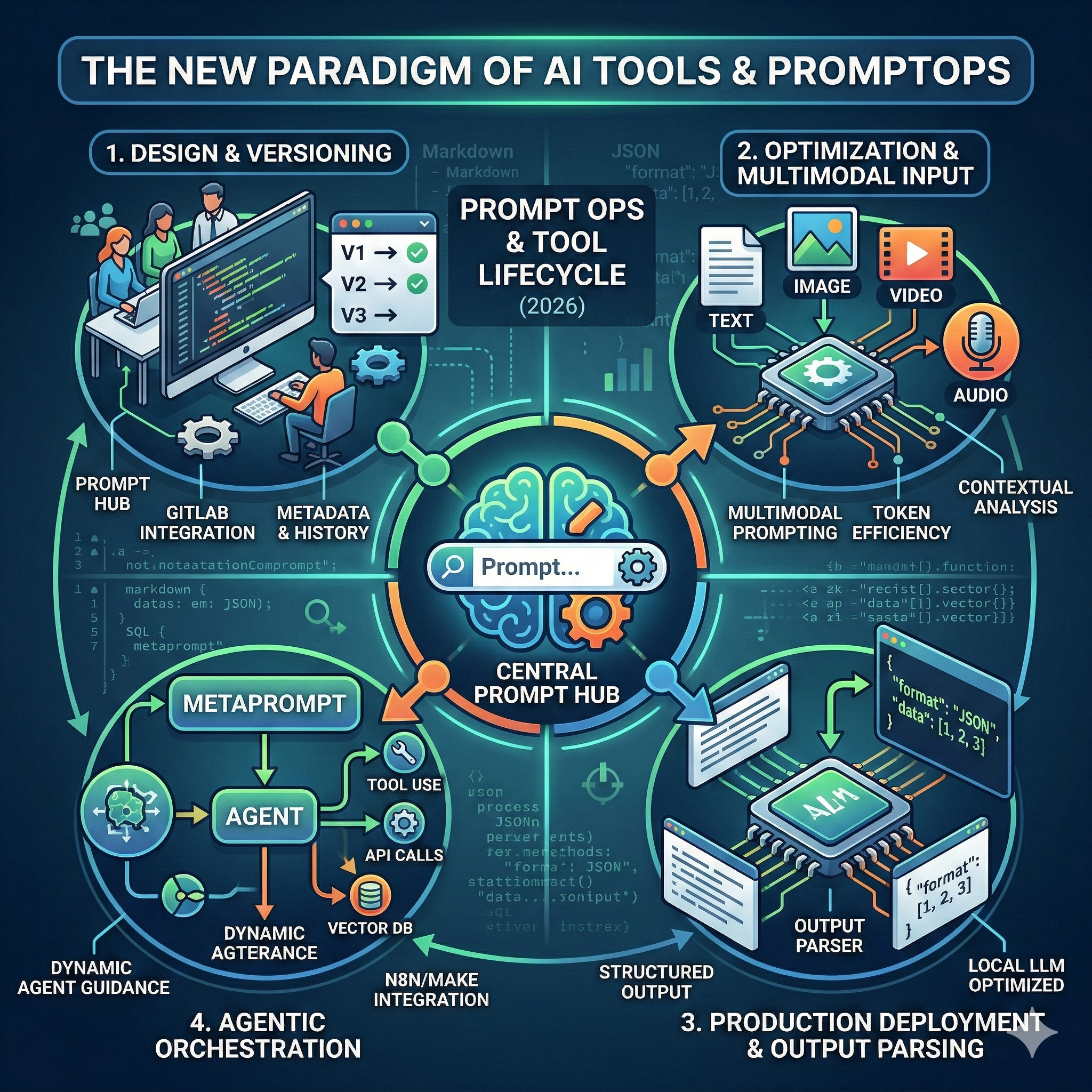

El ecosistema de la Inteligencia Artificial está viviendo una transformación acelerada en cómo los usuarios interactúan con los modelos. En este inicio de 2026, las noticias se centran en el paso del «chat libre» hacia sistemas estructurados de «PromptOps». Nuevas plataformas permiten gestionar, versionar y optimizar los prompts de manera colaborativa, integrándolos directamente en el ciclo de vida del desarrollo de software. No se trata solo de escribir mejor, sino de gestionar la interacción con la IA de forma profesional.

La gestión artesanal de prompts en hojas de cálculo está desapareciendo rápidamente. Plataformas dedicadas como LangSmith, PromptHub y las nuevas integraciones de GitLab y GitHub permiten ahora rastrear el rendimiento de los prompts, comparar versiones y gestionar costos asociados a las APIs de los modelos de lenguaje (LLMs). Esta tendencia, conocida como PromptOps, facilita la colaboración directa entre desarrolladores, expertos de dominio y diseñadores de prompts, garantizando que los cambios en las instrucciones no degraden el rendimiento general del sistema. La estandarización de estos flujos de trabajo es crucial para las empresas que despliegan IA en producción, reduciendo el riesgo de «olvido catastrófico» de los modelos y mejorando significativamente la consistencia de las respuestas en entornos complejos de automatización agéntica.

Con la consolidación de modelos como Gemini 3.1 Pro y Claude 4.6 Sonnet, el prompt ha dejado de ser meramente textual. El prompting multimodal permite ahora enviar imágenes, videos o audio junto con las instrucciones para obtener análisis contextuales profundos. Simultáneamente, gana terreno el prompting estructurado. Herramientas avanzadas de «output parser» aseguran que la IA devuelva los datos en formatos específicos (como JSON compatible con esquemas de bases de datos vectoriales), eliminando la necesidad de posprocesamiento manual. El diseño de estas instrucciones requiere una precisión técnica elevada para optimizar los «tokens de contexto», especialmente con la creciente popularidad de los modelos locales que operan en infraestructuras self-hosted, donde la eficiencia en el uso de recursos es vital para la viabilidad económica del proyecto.

Una tendencia clave detectada en los reportes de industria es cómo los prompts gestionan ahora la orquestación dinámica de agentes autónomos. Las herramientas de automatización visual, reflejadas en arquitecturas complejas de flujos, utilizan metaprompts para guiar a los agentes en el uso de herramientas específicas. Por ejemplo, un prompt dinámico puede instruir a un agente sobre qué API llamar, qué parámetros buscar en una base de datos local y cómo formatear la respuesta para el siguiente nodo en el flujo de trabajo de n8n o Make. Esta capa de instrucciones lógicas permite que los sistemas actúen autónomamente sin perder el alineamiento con los objetivos de negocio y las políticas de seguridad de la organización, creando automatizaciones mucho más resilientes e inteligentes.

La profesionalización del prompting mediante PromptOps y las instrucciones multimodales marca un hito en 2026. Estas noticias reflejan que dominar la interacción estructurada con la IA es tan vital como el modelo mismo. Este avance permite pasar de la experimentación a la producción robusta, integrando la inteligencia en el núcleo operativo empresarial, maximizando el control y la eficiencia en los despliegues.

Fuentes consultadas: * Gartner Strategic Technology Trends 2026: Prompt Engineering to PromptOps Evolution.